微软推出 “从错误中学习” 模型训练法,号称可模仿人类学习过程

当下 OpenAI GPT-4 和谷歌 aLM-2 等大语言模型在自然语言处理(NLP)任务,及思维链(chain-of-thought,CoT)推理的数学难题任务中都有不错的表现。

但例如 LLaMA-2 及 Baichuan-2 等开源大模型,在处理相关问题时则有待加强。为了提升开源这些大语言模型的思维链推理能力,研究团队提出了 LeMA 方法。这种方法主要是模仿人类的学习过程,通过“从错误中学习”,以改进模型的推理能力。

▲ 图源 相关论文

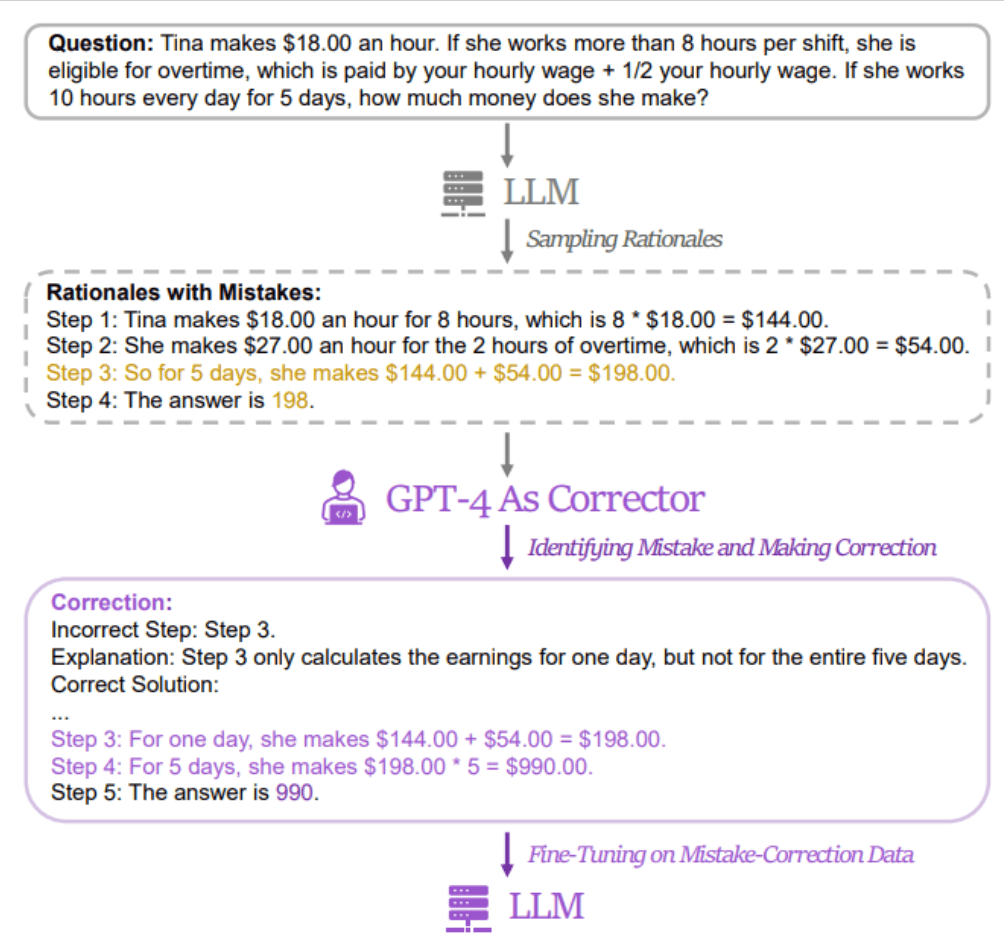

IT之家发现,研究人员的方法是使用一对包含“错误解答”与“修正后正确答案”的数据来微调相关模型。为取得相关数据,研究人员收集了 5 个不同大语言模型(包括 LLaMA 及 GPT 系列)的错误答案和推理过程,再以 GPT-4 作为“订正者”,提供修正后的正确答案。

据悉,修正后的正确答案中包含三类信息,分别是原推理过程中错误片段、原推理过程出错的原因、以及如何修正原方法以获得正确答案。

研究人员采用 GSM8K 及 MATH,来测试 LeMa 训练法对 5 个开源大模型的效果,结果显示,以改进过的 LLaMA-2-70B 为例,在 GSM8K 的准确率分别为 83.5% 及 81.4%,在 MATH 则分别为 25.0% 及 23.6%。

目前研究人员已将 LeMA 的相关资料公开在 GitHub 上,感兴趣的小伙伴们可以点此跳转。

免责声明:本文为转载,非本网原创内容,不代表本网观点。其原创性以及文中陈述文字和内容未经本站证实,对本文以及其中全部或者部分内容、文字的真实性、完整性、及时性本站不作任何保证或承诺,请读者仅作参考,并请自行核实相关内容。